高速GPUを1時間50円~

高速コンピューティング

10日間無料トライアル実施中!

詳しい資料はこちら

10日間無料トライアル

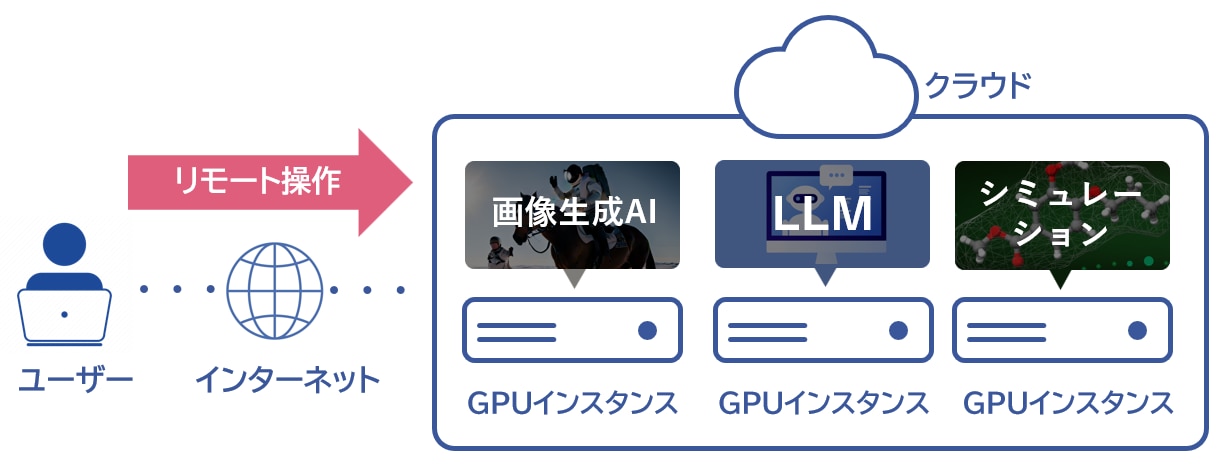

画像生成AI

Stable Diffusionなどの画像生成AIを高速に処理できるGPUクラウドを業界最安級の1時間50円からご利用いただけます。

画像認識

画像認識などモデルのトレーニングに「NVIDIA A100」を搭載した大容量GPUメモリのインスタンスを選択できます。

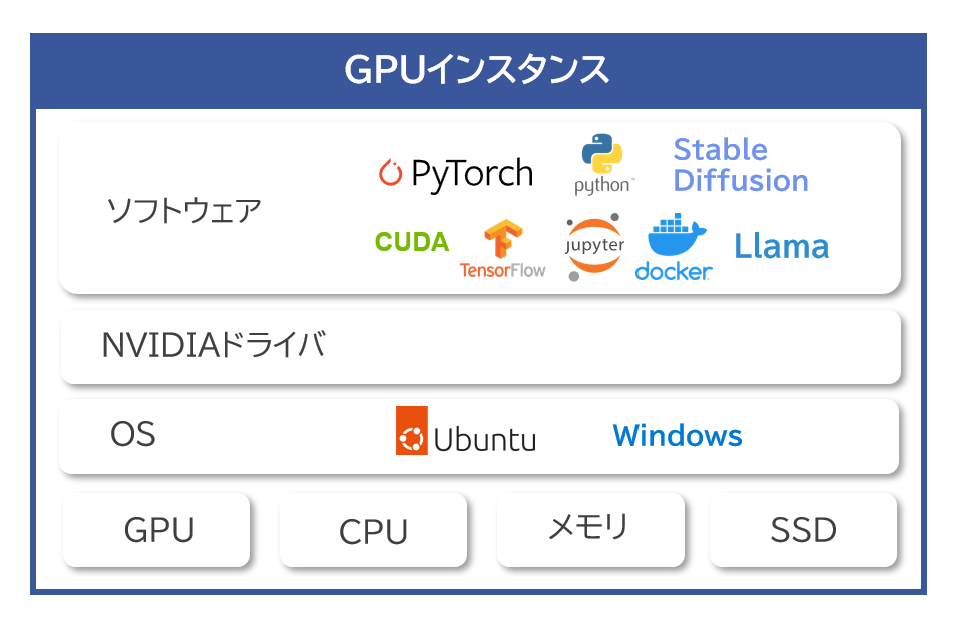

機械学習

PyTorch、TensorFlow、JupyterLabなど機械学習で人気のソフトウェアがプリインストールされているため、すぐに開発に取りかかれます。

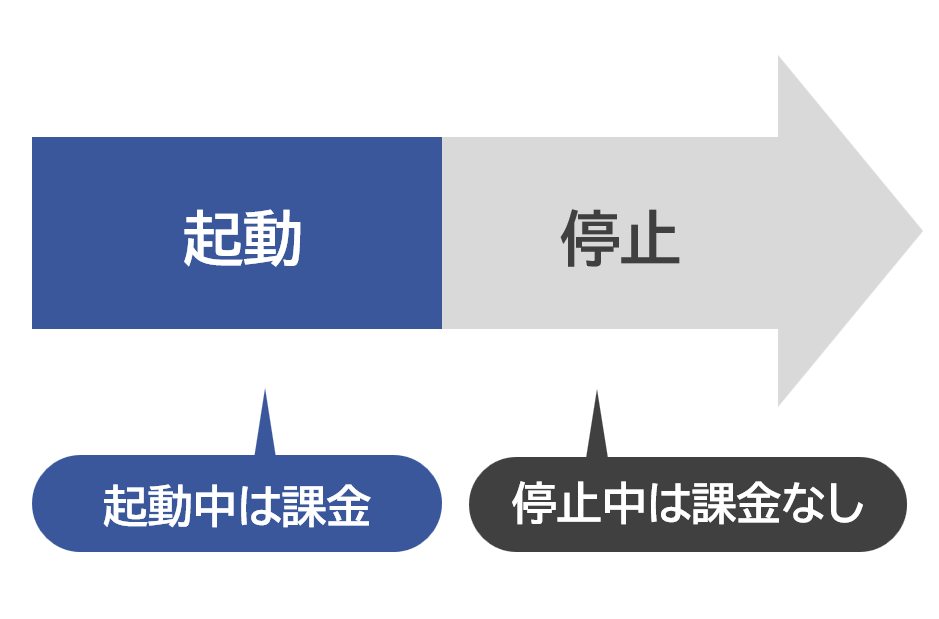

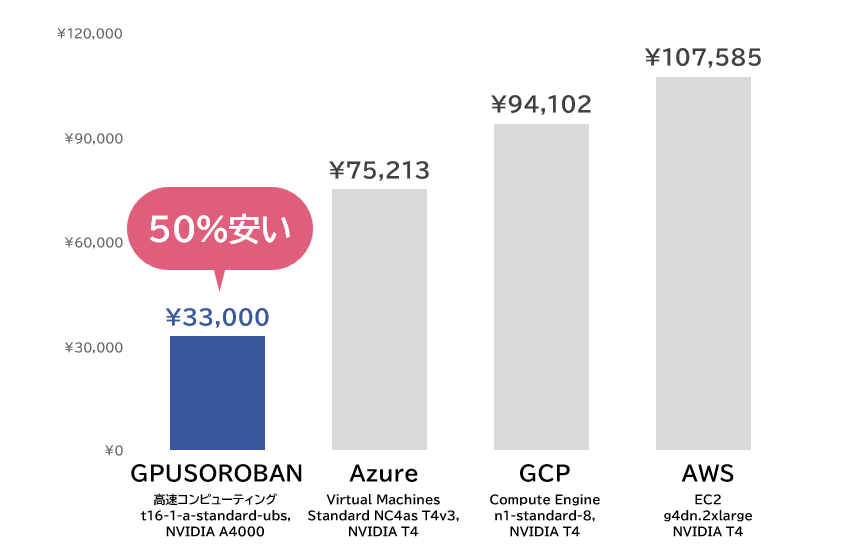

業界最安級

AWS・GCP・AzureのGPUクラウドと比較して、50%以上安い業界最安級の料金で利用できます。データ転送料の追加コストもかかりません。

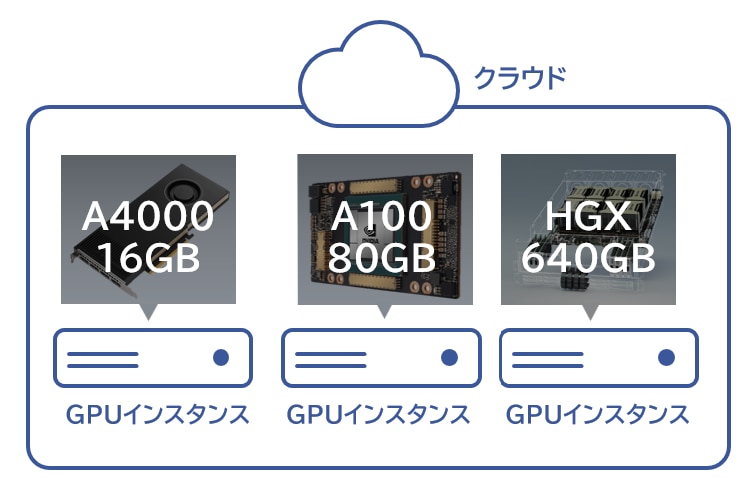

生成AIに最適なGPU

NVIDIA A100など機械学習に最適な高速・大容量GPUを用意しています。GPUメモリは16GB~640GBまで選択できます。

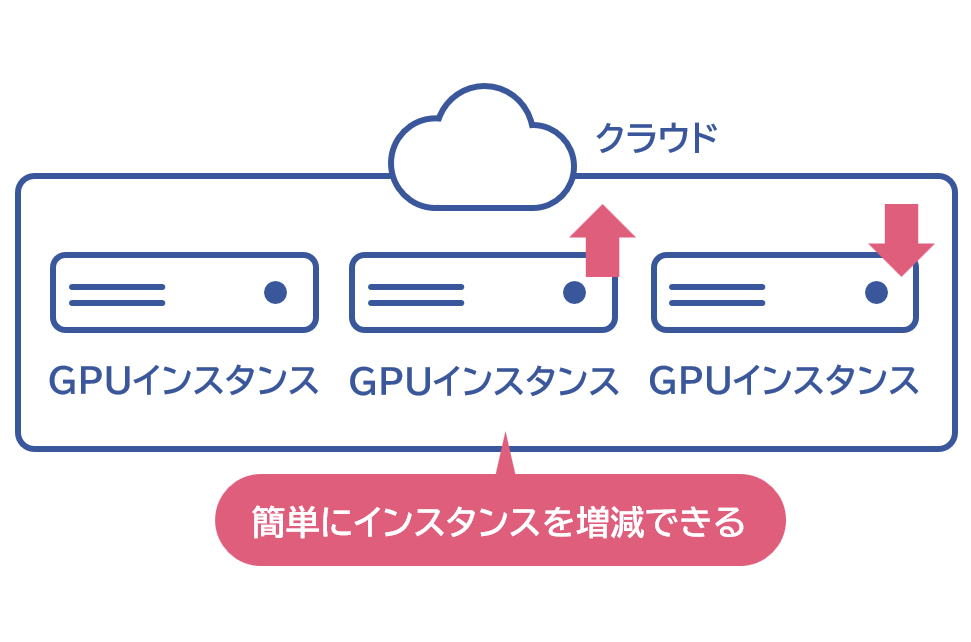

クラウド経験不要

3分で設定が完了する手軽なサービスです。他社GPUクラウドと比較して設定項目が少なく、クラウドインフラ未経験の方でも簡単に利用できます。

高速コンピューティングは、NVIDIAの高性能GPUを業界最安級の料金で提供しています。AWS・GCP・AzureなどのGPUクラウドと比較して50%以上安く、初期費用やデータ転送料の追加コストもかかりません。サーバールームや電源、空調設備を必要とせず、サーバーの管理コストも削減できます。

| サービス |

GPUSOROBAN |

Azure | GCP | AWS | GCP | Azure | AWS |

| NVIDIA T4搭載 | NVIDIA T4搭載 | NVIDIA T4搭載 | NVIDIA V100搭載 | NVIDIA V100搭載 | NVIDIA V100搭載 | ||

| プラン | s16-1-a-standard-ubs | Standard_NC4as_T4_v3 | n1-standard-8,T4 | g4dn.2xlarge | n1-highmem-8,V100 | Standard_NC6s_v3 | P3.2xlarge |

| 従量課金の場合(1h) | ¥50 | ¥103 | ¥128 | ¥147 | ¥423 | ¥515 | ¥608 |

| 月額費用の場合 | ¥33,000 | ¥75,213 | ¥94,102 | ¥107,585 | ¥315,496 | ¥377,191 | ¥444,547 |

| GPU | NVIDIA A4000×1枚 | NVIDIA T4×1枚 | NVIDIA T4×1枚 | NVIDIA T4×1枚 | NVIDIA V100×1枚 | NVIDIA V100×1枚 | NVIDIA V100×1枚 |

| GPUメモリ | 16GB | 16GB | 16GB | 16GB | 16GB | 16GB | 16GB |

| vCPU | 11コア | 4コア | 8コア | 8コア | 8コア | 6コア | 8コア |

| システムメモリ | 50GB | 28GB | 30GB | 32GB | 52GB | 112GB | 61GB |

| 演算性能(FP32) | 19.2TFLOPS | 8.1TFLOPS | 8.1TFLOPS | 8.1TFLOPS | 14TFLOPS | 14TFLOPS | 14TFLOPS |

| リージョン | 日本 | 日本 | 日本 | 日本 | 米国 | 日本 | 日本 |

|

インスタンス |

s16-1-a | t40-1-a | t80-1-a | t40-8-a | t80-8-a |

| 特徴 | NVIDIA A4000 16GBx1枚 GPUメモリ 16GB Ubuntu OS |

NVIDIA A100 40GBx1枚 |

NVIDIA A100 80GBx1枚 GPUメモリ 80GB |

NVIDIA A100 40GBx8枚 |

NVIDIA A100 80GBx8枚 GPUメモリ 640GB |

|

従量課金の場合 |

¥50 | ¥361 | ¥398 | - | - |

|

月額課金の場合 |

¥33,000 | ¥223,133 | ¥243,631 | ¥1,320,184 | ¥1,985,940 |

| GPU | NVIDIA A4000 16GBx1枚 | NVIDIA A100 40GBx1枚 | NVIDIA A100 80GBx1枚 | NVIDIA A100 40GBx8枚 | NVIDIA A100 80GBx8枚 |

| GPUメモリ | 16GB | 40GB | 80GB | 320GB | 640GB |

| vCPU | 11コア | 15コア | 20コア | 128コア(物理コア) | 128コア(物理コア) |

| システムメモリ | 50GB | 115GB | 220GB | 1TB | 2TB |

| ストレージ |

standard:100GB |

standard:100GB |

standard:100GB 500GB・1TBは別途料金 |

15TB |

15TB |

| OS |

Ubuntu |

Ubuntu バージョン詳細 |

Ubuntu バージョン詳細 |

Ubuntu バージョン詳細 |

Ubuntu バージョン詳細 |

|

プリインストール |

CUDA,PyTorch等 |

CUDA,PyTorch等 |

CUDA,PyTorch等 |

CUDA,PyTorch等 |

CUDA,PyTorch等 |

| 演算性能(FP32) | 19.2TFLOPS | 19.5TFLOPS | 19.5TFLOPS | 156TFLOPS | 156TFLOPS |

| 演算性能(TF32) | 153TFLOPS | 312TFLOPS | 312TFLOPS | 2.5PFLPOS | 2.5PFLPOS |

| 演算性能(FP64) | - | 9.7TFLOPS | 9.7TFLOPS | 77TFLOPS | 77TFLOPS |

「AIスパコンクラウド」は、NVIDIA H200を搭載したGPUインスタンスが業界最安級で使えるクラウドサービスです。

LLMやマルチモーダルAIの計算時間を短縮します。料金はAWSのH200インスタンスと比較して70%安く設定しており、大幅なコストダウンが可能です。

GPUインスタンス構成は1台のスタンドアロン構成から、複数連結したクラスタ構成まで選択でき、必要なリソースだけ利用可能です。

| GPU | NVIDIA A4000 | NVIDIA V100 | NVIDIA T4 |

|---|---|---|---|

| 世代 | Ampere | Volta | Turing |

| GPUメモリ | 16GB | 16GB | 16GB |

| 演算性能(FP32) | 19.2TFLOPS | 14TFLOPS | 8.1TFLOPS |

| 演算性能(TF32) | 153.4TFLOPS | 112 TFLOPS | 37.4TFLOPS |

| GPU | NVIDIA A100 80GB | NVIDIA V100 16GB |

|---|---|---|

| 世代 | Ampere | Volta |

| GPUメモリ | 80GB | 16GB |

| GPUメモリ帯域幅 | 1,935GB/秒 | 900GB/秒 |

| 演算性能(FP32) | 19.5TFLOPS | 14TFLOPS |

| 演算性能(TF32) | 312TFLOPS | 112 TFLOPS |

| 演算性能(FP64) | 9.7TFLOPS | 7TFLOPS |

| GPUサーバー | NVIDIA HGX A100 | NVIDIA DGX-1 V100 |

|---|---|---|

| GPU | NVIDIA A100 80GB x8枚 | NVIDIA V100 32GB x8枚 |

| GPUメモリ | 総計640GB | 総計256GB |

| GPUメモリ帯域幅 | 2,039GB/秒 |

1,134GB/秒 |

|

GPU間の通信帯域幅 |

600GB/秒 | 300GB/秒 |

| 演算性能(FP32) | 156TFLOPS | 120TFLOPS |

| 演算性能(TF32) | 2.5PFLOPS | 1PFLOPS |

| 演算性能(FP64) | 77TFLOPS | 60TFLOPS |

SIer

AIベンチャー

電機メーカー

光学機器メーカー

食品メーカー

ゼネコン/サブコン

インフラ(通信・水道)

学術研究機関

高速コンピューティングは、石川県に所有するGPU専用データセンターからサービスを提供しており、累計10,000枚以上のGPUの運用実績があります。GPUのプロフェッショナルによる技術サポートが無料で受けられます。基本的なレクチャーから、環境構築に関するアドバイスまで幅広く対応しています。

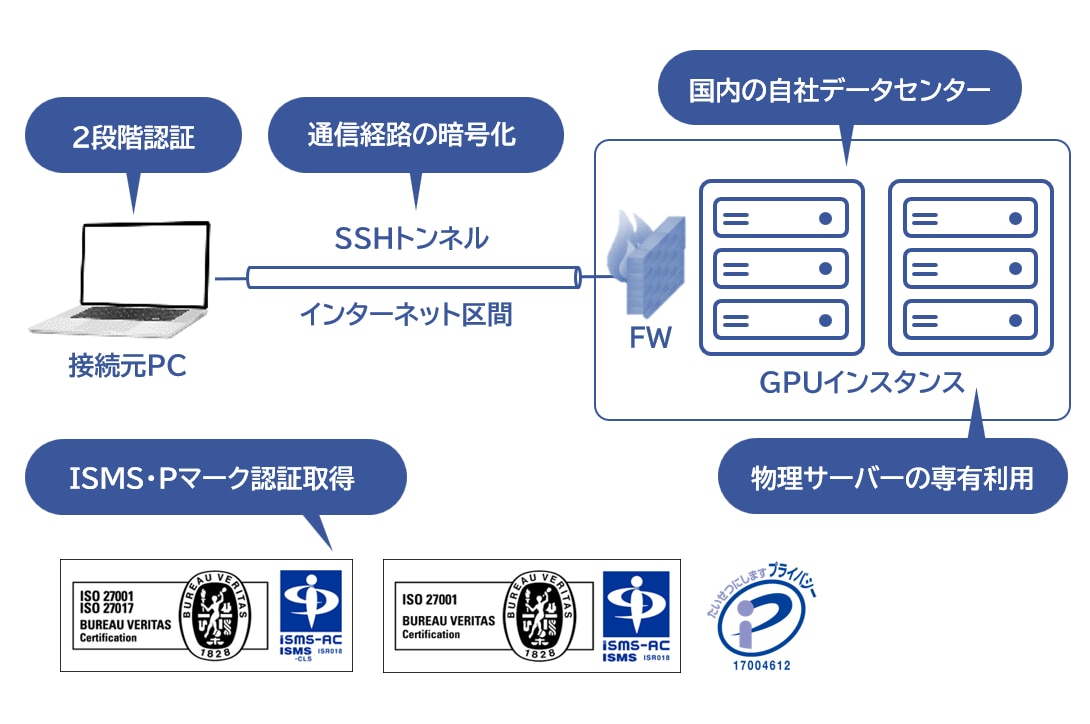

ハイレゾはISMS認証(ISO27001)およびISMSクラウドサービスセキュリティ認証(ISO27017)、Pマークを取得済みで、総合的なセキュリティ対策を実施しています。通信経路はSSH接続によって暗号化することで安全に保護しています。物理サーバを専有する形でインスタンスを提供しているため、他のユーザーからの影響を受けません。

ハイレゾはNVIDIAのクラウドパートナー「NVIDIA Partner Network Cloud Partner」に認定されています。

NPN Partner Award 2022においては「Best CSP Partner Of the Year」を受賞しています。

技術サポートはありますか?

経験豊富な日本人スタッフによる技術サポートを無料でご利用いただけます。

使い方のレクチャーから環境構築のアドバイスまで対応いたします。

技術サポートに関しては内容によって対応できかねることがありますので、予めご了承ください。

ストレージの容量を増やすことは可能でしょうか?

可能です。ストレージの容量を増やす場合は、お問い合わせください。

NVIDIA A100を搭載したインスタンスも他社より安いのでしょうか?

NVIDIA A100を搭載したインスタンスもハイパースケーラーの40%~50%安い料金で提供しています。

| 社名 | 株式会社ハイレゾ |

|---|---|

| 設立 | 2007年12月 |

| 本社 | 東京都新宿区市谷田町3丁目24−1 |

| 社員数 | 124名(派遣・業務委託含む) 2025年11月現在 |

| 役員 |

代表取締役 志倉 喜幸 取締役 小林 稔 取締役 小堀 敦史 取締役 杉村 大輔 社外取締役 柿原 正郎 社外取締役 森 学 監査役 尾上 真美 社外監査役 片寄 裕市(東京理科大学イノベーション・キャピタル株式会社代表取締役) |

| 株主 |

志倉喜幸/TUSIC投資事業有限責任組合/WCP HR投資事業有限責任組合/ |

| 認証 |

ISO27001認証(ISO/IEC 27001:2013 / JIS Q27001:2014) ISO27017認証(JIP-ISMS517-1.0) Pマーク認証 |

| 主要取引先 | エヌビディア合同会社、北陸電力株式会社、豊田通商株式会社、株式会社アルゴグラフィックス、 NTTPCコミュニケーションズ株式会社、テックウインド株式会社、 株式会社クレスコ、株式会社PALTEK、アプライド株式会社、株式会社サードウェーブ その他取引先多数 |