【Stable Diffusion Web UI】ControlNet Depthの使い方

この記事では、ControlNet Depthについて解説しています。

ControlNet Depthは、元画像から奥行きや構図を抽出して、別の画像を生成することができます。

目次[非表示]

Stable Diffusionとは

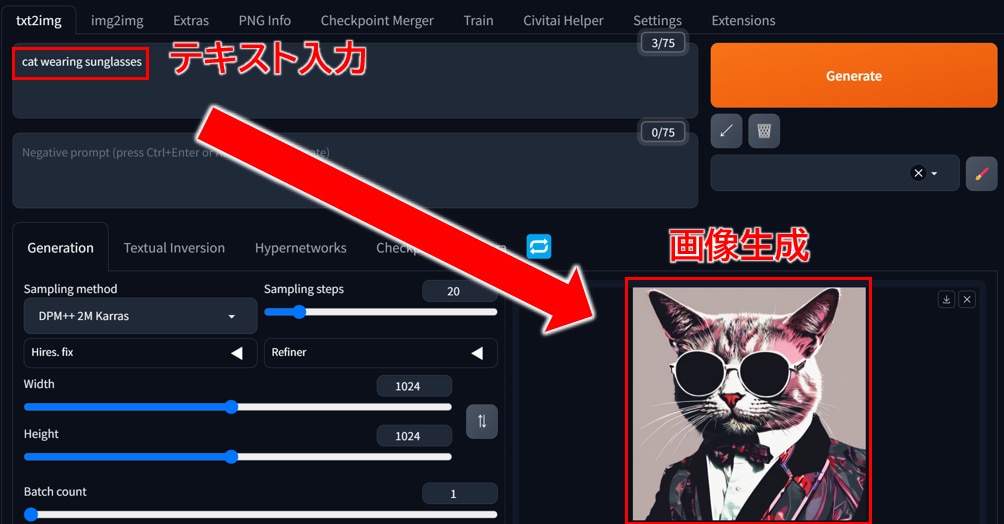

Stable Diffusionは、無料で使える画像生成AIです。テキストを打ち込むと、それに応じた画像が生成されるしくみです。人物や動物、風景など、さまざまな画像を生成できます。

例えば、「サングラスをかけた猫」と入力するとそのような画像が生成されます。生成する画像のスタイルも多様でイラストや写真、水彩画やアニメ調など、自分の好きなテーマでAIに生成してもらうことができます。

Stable Diffusion Web UI(AUTOMATIC1111版・Forge版)とは

Stable Diffusion Web UI(AUTOMATIC1111版・Forge版)ブラウザを通じて手軽に画像生成を行える無料のWEBアプリケーションで、Google Chromeなどの主要なブラウザで利用できます。

プログラミングを一切必要とせず、WEB UIによる簡単なグラフィカルな操作が可能です。Stable Diffusion Web UIをローカルPCにインストールして使用する、もしくはクラウドサーバーにインストールして使用します。

Stable Diffusion Web UIに関する全般的な使い方については、以下の記事でまとめていますので、あわせてご覧ください。

ControlNet Depthとは

ControlNetはStable Diffusionの拡張機能の一つであり、その機能はContorlNetのモデルによって異なります。

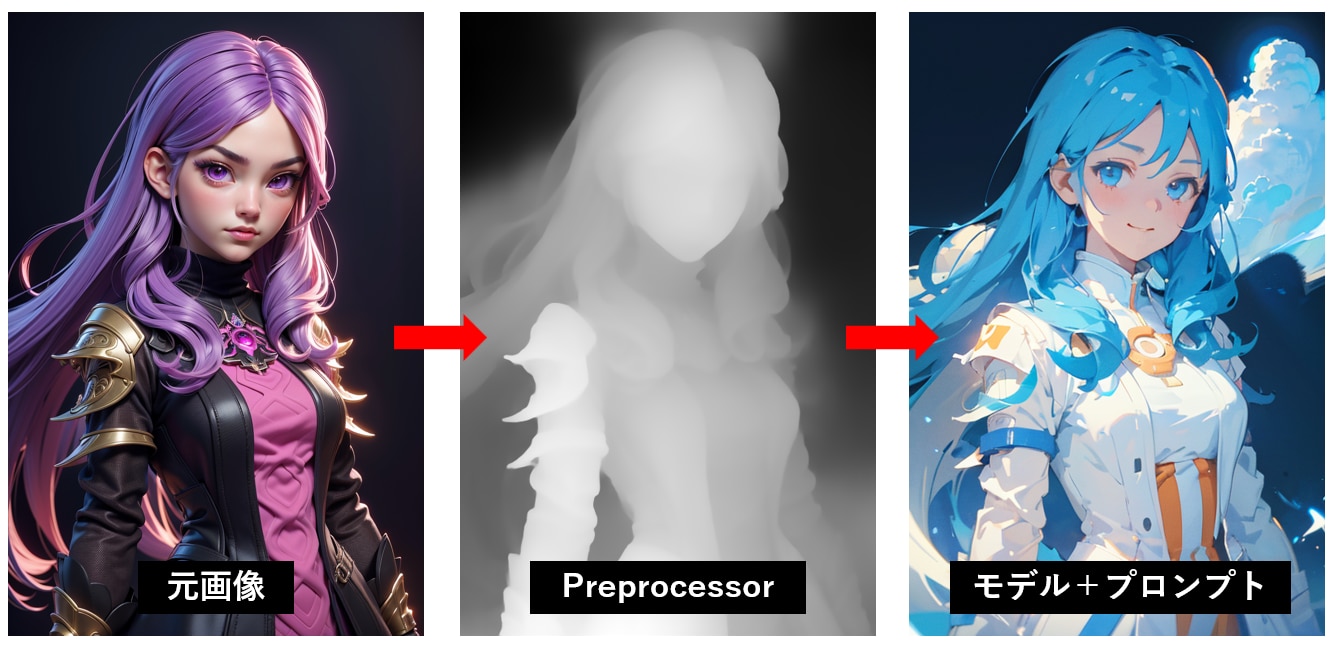

ControlNet Depthは、元画像から奥行きや構図を抽出して、別の画像を生成することができます。

この記事ではDepthを解説していきます。

Depth以外のモデルをお探しの方は、以下のContorlNetのまとめ記事をご覧ください。

ControlNet Depthのインストール

ContorlNet Depthは、Stable Diffusion Web UIの拡張機能のContorlNetの1つのモデルです。

拡張機能のContorlNetをインストールして、ControlNet Depthのモデルを設定することで利用できるようになります。

ContorlNetのインストールおよびモデルの設定方法は以下の記事をご覧ください。

上記記事にControlNet Depthモデルのダウンロード手順が含まれます。

[control_v11f1p_sd15_depth_fp16]がDepthのモデル名になります。

ControlNet Depthの使い方

ControlNet Depthの使い方は以下の手順のとおりです。

Stable Diffusion Web UIの[txt2img]のタブを開きます。

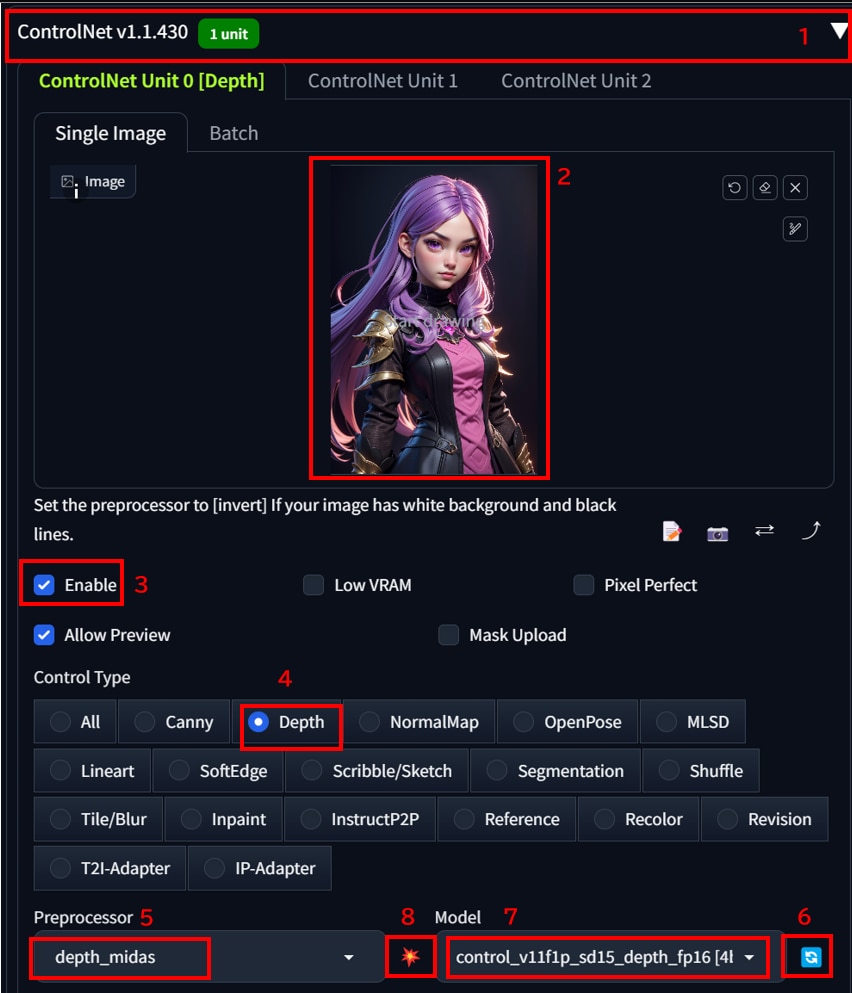

- [ControlNet v****]の[◀]ボタンをクリックし、メニューを開きます。

※Forge版の場合は、[ControlNet Integrated◀]ボタンをクリックし、メニューを開きます。 - [Single Image]の[ここに画像をドロップ -または-クリックしてアップロード]に、元画像をアップロードします。

- [Enable]にチェックを入れます。

- [Depth]にチェックを入れます。

- [Preprocessor]のプルダウンメニューから[depth_midas]を選択します。

- [Model]の横にある[更新]アイコンをクリックします。

- [Model]のプルダウンメニューから[control_v11f1p_sd15_depth_fp16]を選択します。

- 特徴抽出をする[💥]のアイコンをクリック

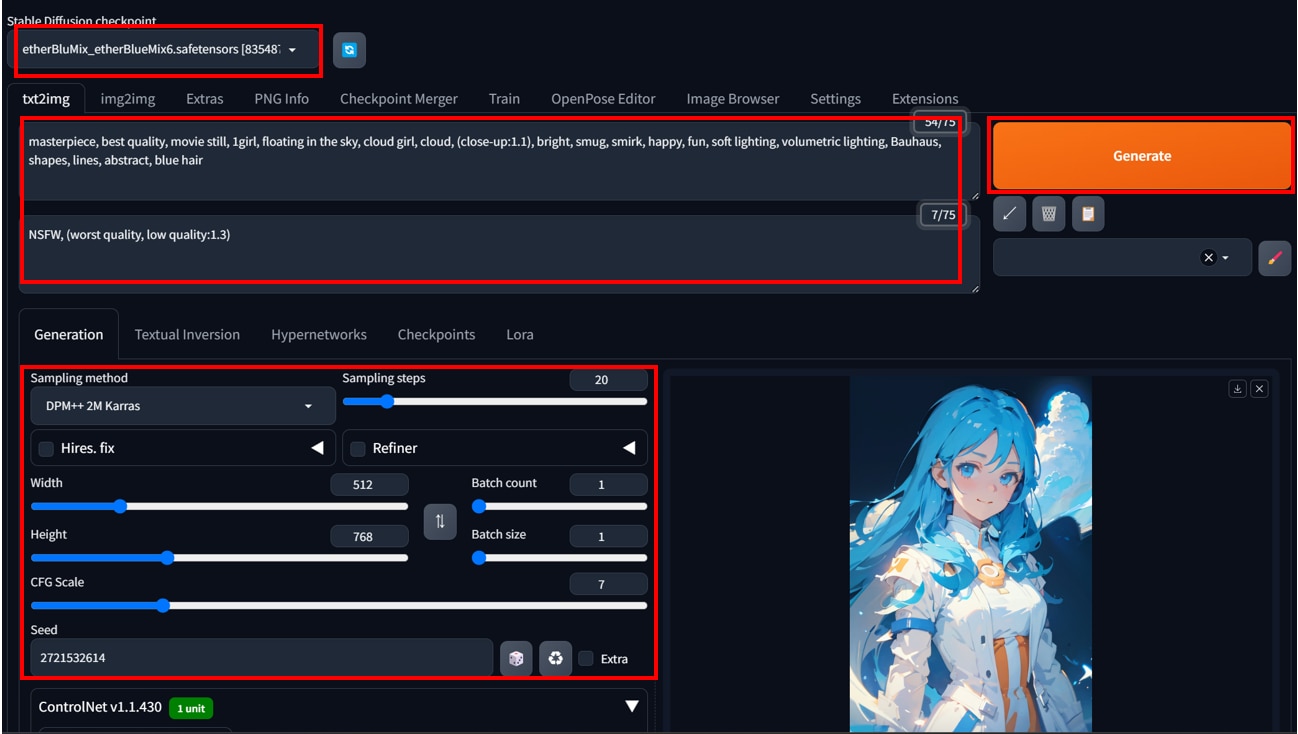

任意のモデル・プロンプト・生成パラメータを設定し、[Generate]ボタンをクリックすると、抽出した深度情報をもとに別の画像が生成されます。

使用したプロンプト、生成パラメータ、モデル情報は以下のとおりです。

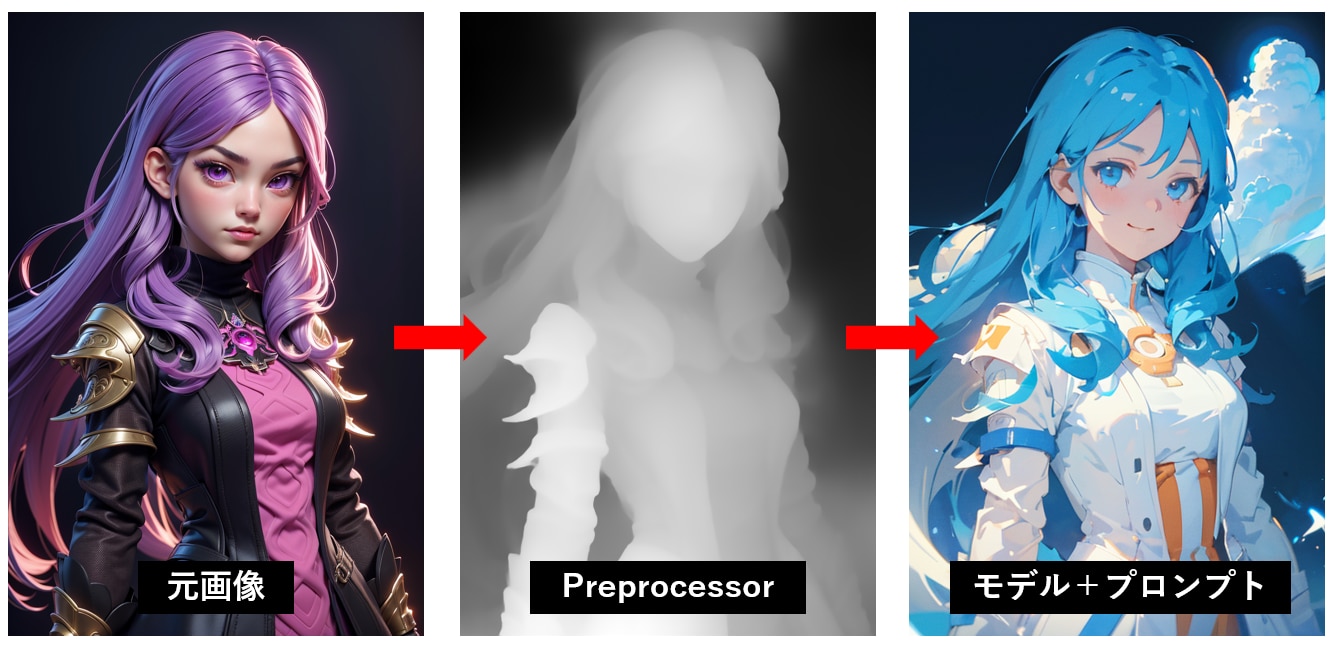

左が[元画像]、真ん中が[抽出した深度情報]、右が[生成画像]になります。

Preprocessorについて

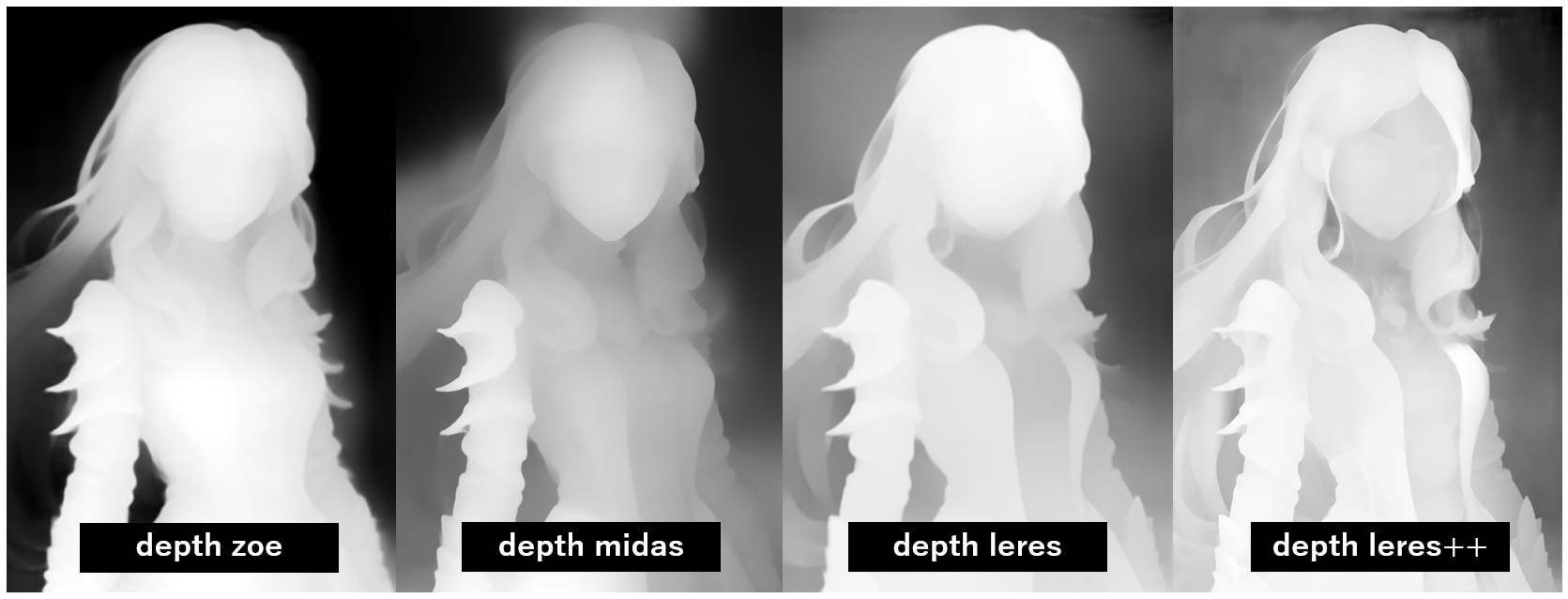

Preprocessorは、depth zoe、depth midas、depth leres、depth leres++の4つがありますが、抽出する深度情報の違いは以下のとおりです。

白が濃い部分は深度が浅く、白が薄い部分は深度が深くなります。

もっと自由な画像生成を

Stable Diffusionを実行する環境で、次のような悩みをお持ちではないでしょうか?

- 画像生成が遅い

- 使いたいGPUが使えない

- GPUメモリ(VRAM)が足りない

- ランタイムがリセットされる度にデータが消えるため、設定のやり直しが大変

- 画像データのバックアップが面倒

- Web UIの起動に時間がかかる

- コンピューティングユニットの制限がストレス

- 動作が不安定

制限を気にせず、高速かつ格安に画像生成がしたいなら、GPUクラウドサービス「GPUSOROBAN」がおすすめです。

まとめ

この記事では、Stable Diffusion Web UIでContorlNet Depthを使用する方法を紹介しました。

ControlNet Depthは、元画像から奥行きや構図を抽出して、別の画像を生成することができます。

Stable DiffusionやControlNetに関する記事を以下のページでまとめていますので、あわせてご覧ください。