【Stable Diffusion Web UI】ControlNetの使い方まとめ+Cannyの紹介

ControlNetはStable Diffusion WebUIの拡張機能の一つで、生成する画像をコントロールすることができます。

この記事では、Stable Diffusion WebUIで、ContorlNetをインストールする方法をまとめて紹介しています。

あわせてControlNetのモデルの1つであるCannyについて紹介します。

目次[非表示]

- 1.Stable Diffusionとは

- 2.Stable Diffusion Web UI(AUTOMATIC1111版・Forge版)とは

- 3.ContorlNetとは

- 3.1.Canny

- 3.2.Inpaint

- 3.3.Openpose

- 3.4.Reference only

- 3.5.Tile

- 3.6.Depth

- 3.7.Scribble

- 3.8.SDXL版ContorlNet

- 4.ControlNetのインストール方法

- 5.ContorlNet専用モデルのダウンロード

- 6.ContorlNet Cannyとは

- 7.事前準備

- 8.ContorlNet Cannyの設定

- 9.ContorlNetをアップデートする方法

- 10.もっと自由な画像生成を

- 11.まとめ

Stable Diffusionとは

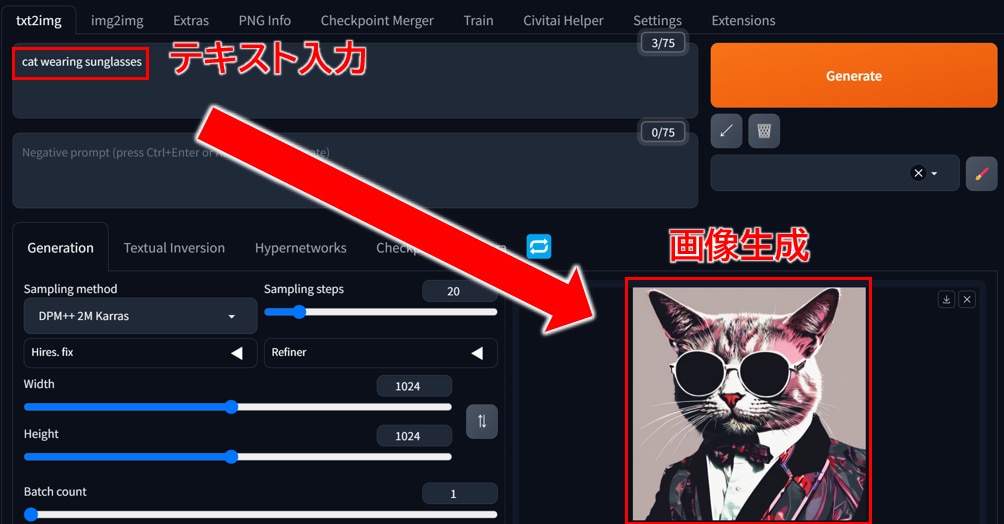

Stable Diffusionは、無料で使える画像生成AIです。テキストを打ち込むと、それに応じた画像が生成されるしくみです。人物や動物、風景など、さまざまな画像を生成できます。

例えば、「サングラスをかけた猫」と入力するとそのような画像が生成されます。生成する画像のスタイルも多様でイラストや写真、水彩画やアニメ調など、自分の好きなテーマでAIに生成してもらうことができます。

インストール不要でブラウザから簡単にStable Diffusionを使える「PICSOROBAN」

PCスペックを気にせず、簡単操作でStable Diffusionを利用できます。

今なら2,000ポイント分のPICSOROBANの画像生成をお試しいただけます。

Stable Diffusion Web UI(AUTOMATIC1111版・Forge版)とは

Stable Diffusion Web UI(AUTOMATIC1111版・Forge版)ブラウザを通じて手軽に画像生成を行える無料のWEBアプリケーションで、Google Chromeなどの主要なブラウザで利用できます。

プログラミングを一切必要とせず、WEB UIによる簡単なグラフィカルな操作が可能です。Stable Diffusion Web UIをローカルPCにインストールして使用する、もしくはクラウドサーバーにインストールして使用します。

Stable Diffusion Web UIに関する全般的な使い方については、以下の記事でまとめていますので、あわせてご覧ください。

ContorlNetとは

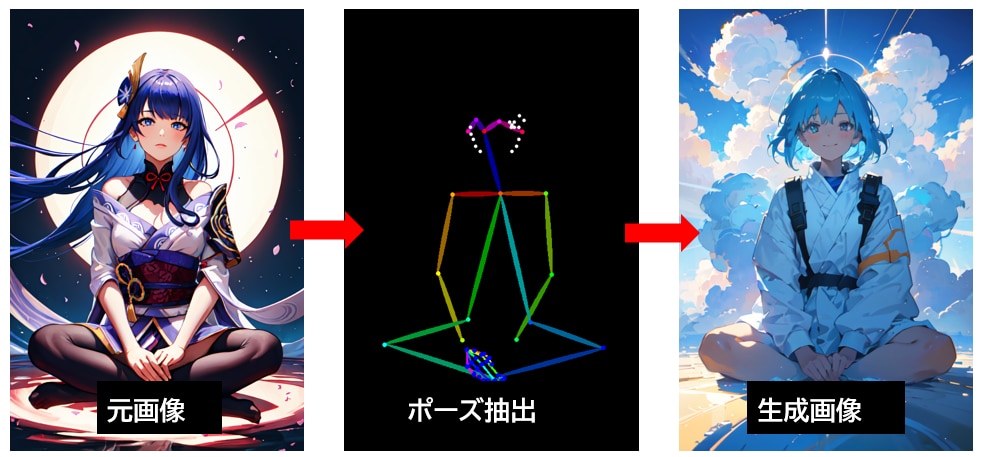

ControlNetはStable Diffusionの拡張機能の一つで、キャラクターのポーズや輪郭を参考画像から指定できる機能です。

プロンプトによる指定では、思っていたポーズと違う画像が生成されることもあります。

ControlNetの拡張機能を使うことで、参考画像のポーズと類似した画像を生成することができます。

写真やイラスト、手書きの絵からポーズや輪郭を型取りして、指定できるため、かなり厳密に参考画像のポーズを再現することが可能です。

ContorlNetは複数の機能があり、その機能はContorlNetのモデルによって異なります。

ContorlNetの代表的なモデルと機能は以下のとおりです。

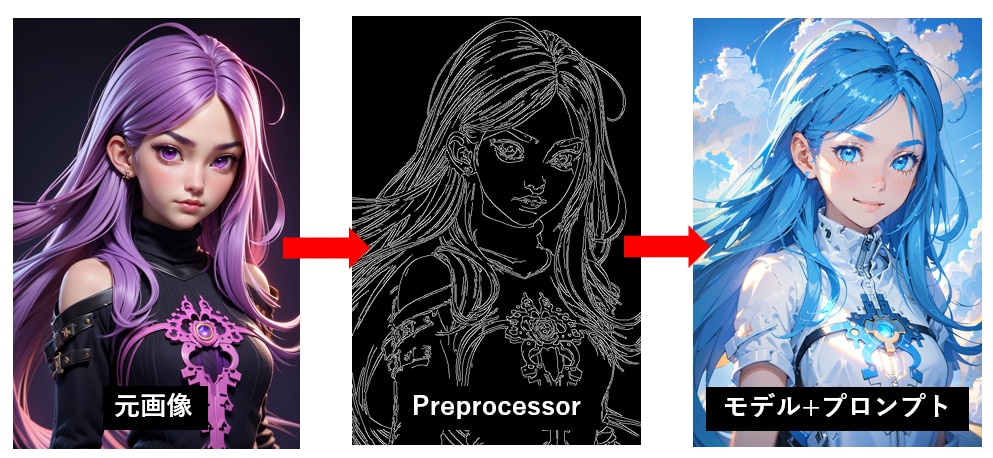

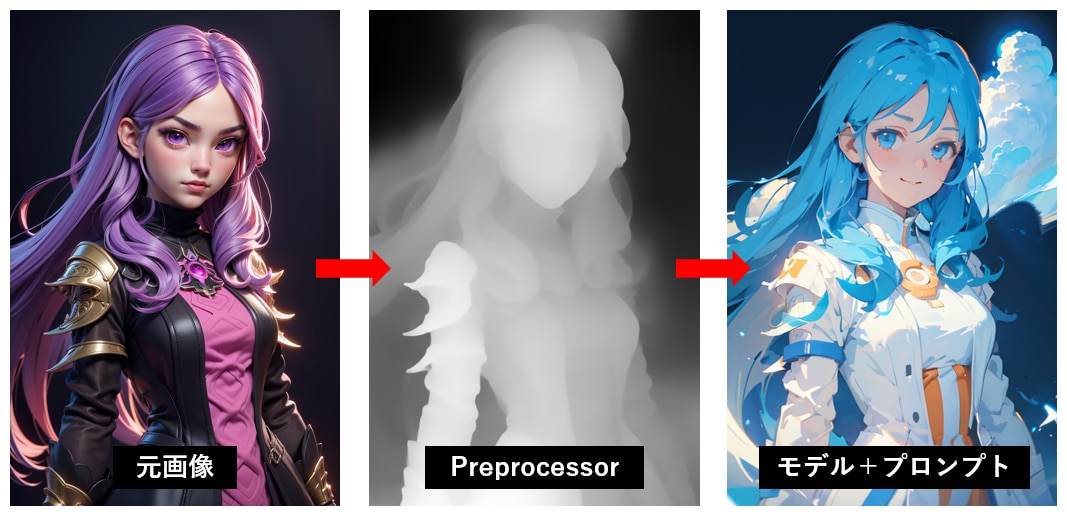

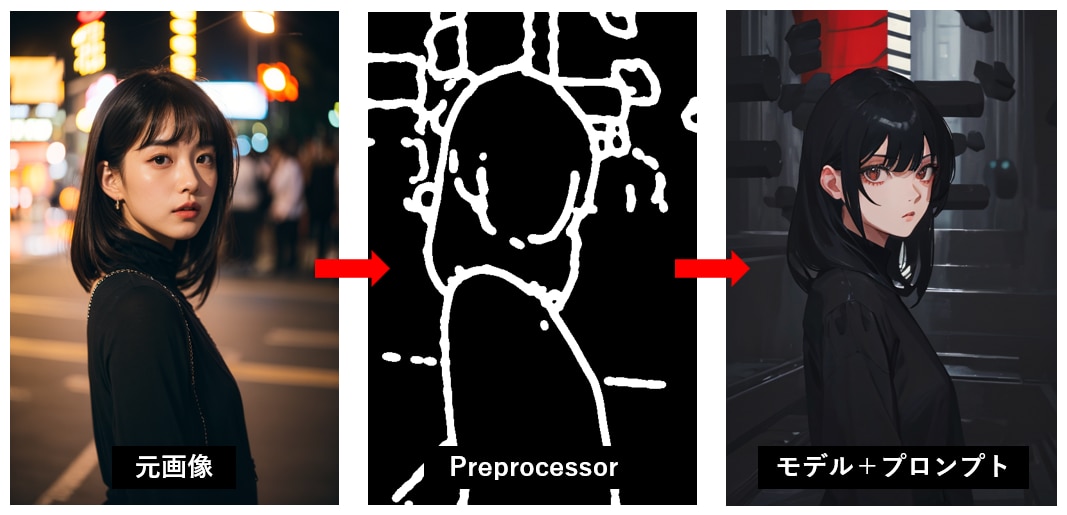

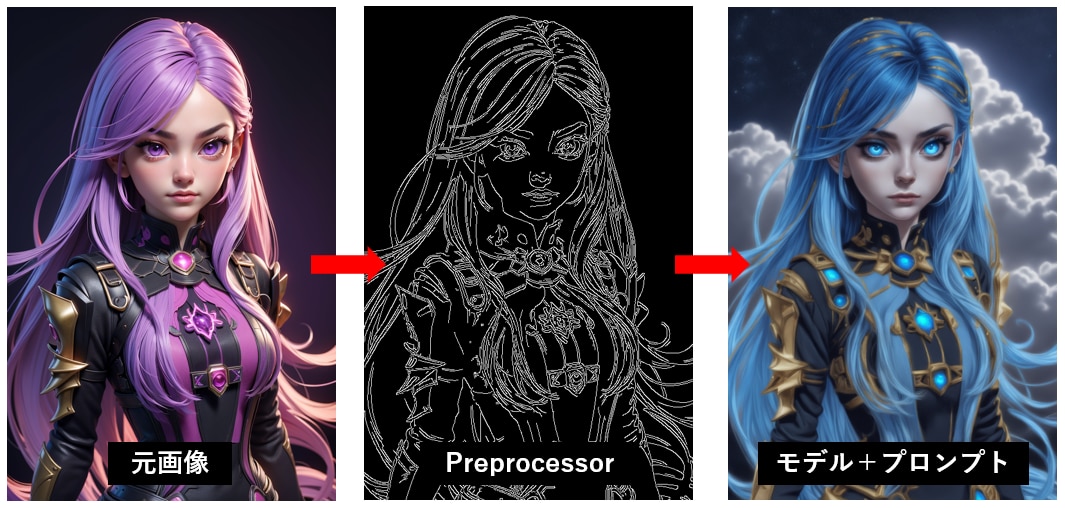

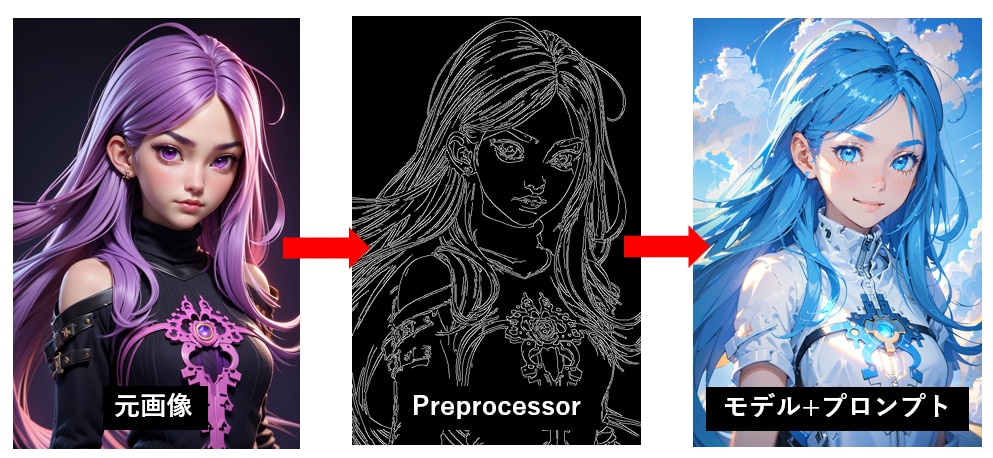

Canny

元画像から線画を抽出して、異なる画風の画像を生成するモデルです。

この記事内でControlNet Cannyの使い方を解説していきます。

Inpaint

ControlNet Inpaintは画像の一部を修正するモデルです。髪型や服装、背景を指定して修正できます。

ControlNet Inpaintの使い方は以下の記事で解説しています。

Openpose

ControlNet Openposeは元画像や棒人間から人物のポーズを検出し、そのポーズを元に画像を生成します。

ControlNet Openposeの使い方は以下の記事で解説しています。

Reference only

ControlNet Reference onlyは、元画像の特徴を含んだ画像を生成できます。

元画像の特徴を継承しながら、服装や背景、画風の変更が可能です。

ControlNet Reference onlyの使い方は以下の記事で解説しています。

Tile

ControlNetのTileは、高解像度の画像を生成するためのモデルです。

画像のアップスケールが可能です。

ControlNet Tileの使い方は以下の記事で解説しています。

Depth

ControlNet Depthは元画像から深度情報を抽出して別画像を生成するモデルです。

ControlNet Depthの使い方は以下の記事で解説しています。

Scribble

ControlNet Scribbleは、手書きの線からリアルな画像を生成するモデルです。

Preprocessorを使用して、元画像から手書きの線を抽出することもできます。

ControlNet Scribbleの使い方は以下の記事で解説しています。

SDXL版ContorlNet

SDXLは高品質・高画質な画像が生成可能なStable Diffusionのモデルです。

ControlNetはバージョンがv1.1.4以降は、Stable Diffusion XL(SDXL)に対応しています。

SDXL版ControlNetのモデルは、別途ダウロードが必要です。

SDXL版ControlNetのインストール方法は、以下の記事で解説しています。

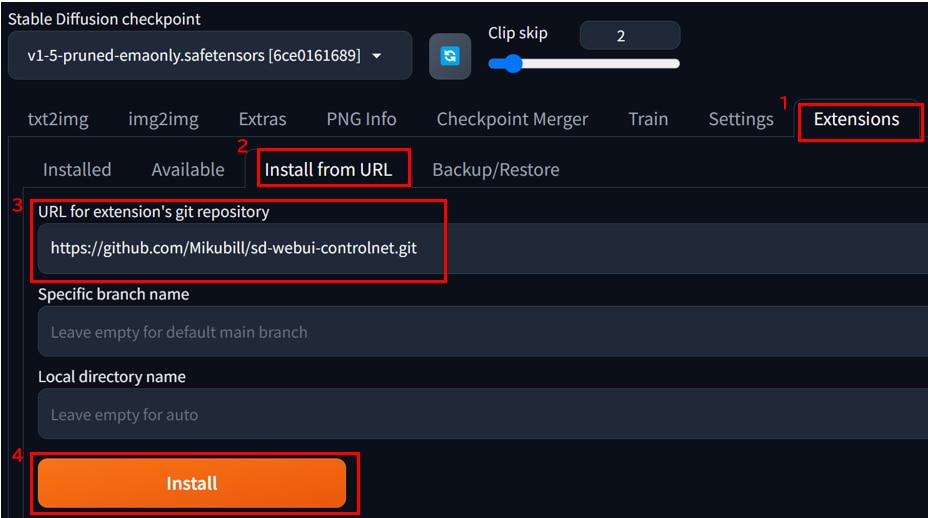

ControlNetのインストール方法

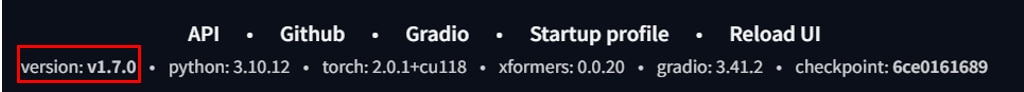

Stable DiffusionとControlNetのバージョンが合わないと動作しませんので、ご注意ください。

これから設定するControlNetのバージョンはv1.1430ですが、Stable Diffusionのバージョンv1.5~v1.7に対応しています。

Stable Diffusionのバージョンは、Stable Diffusion Web UIのフッターで確認できます。

この記事ではStable Diffusion WebUIのバージョンv1.7を扱います。

ContorlNetをインストールする場合の手順は以下のとおりです。

- Stable Diffusion WebUIの[Extensions]タブを開きます。

- [Install from URL]タブを開きます。

- [URL for extension’s git repository]にControlNetをインストールするURL(

[Install]をクリックし、インストールを開始します。

[Installed]タブを開き、拡張機能がインストールされたことを確認し、[Apply and restart UI]ボタンをクリックし、Web UIに変更を反映させます。

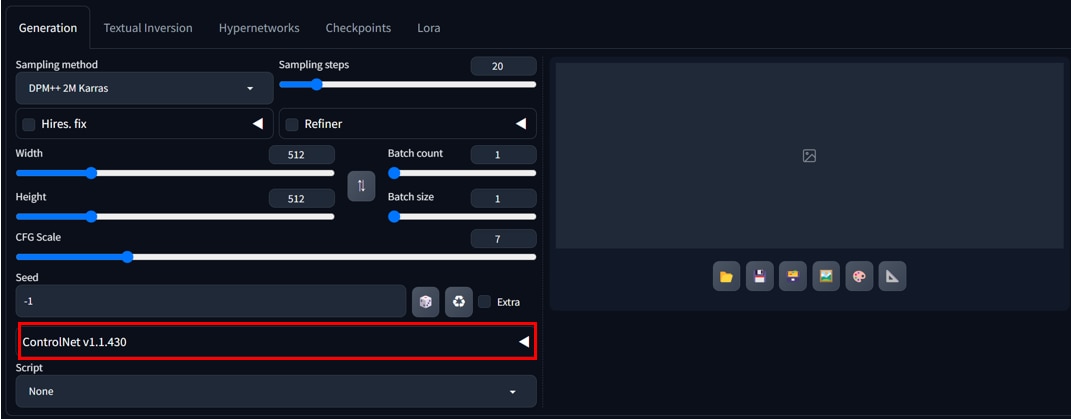

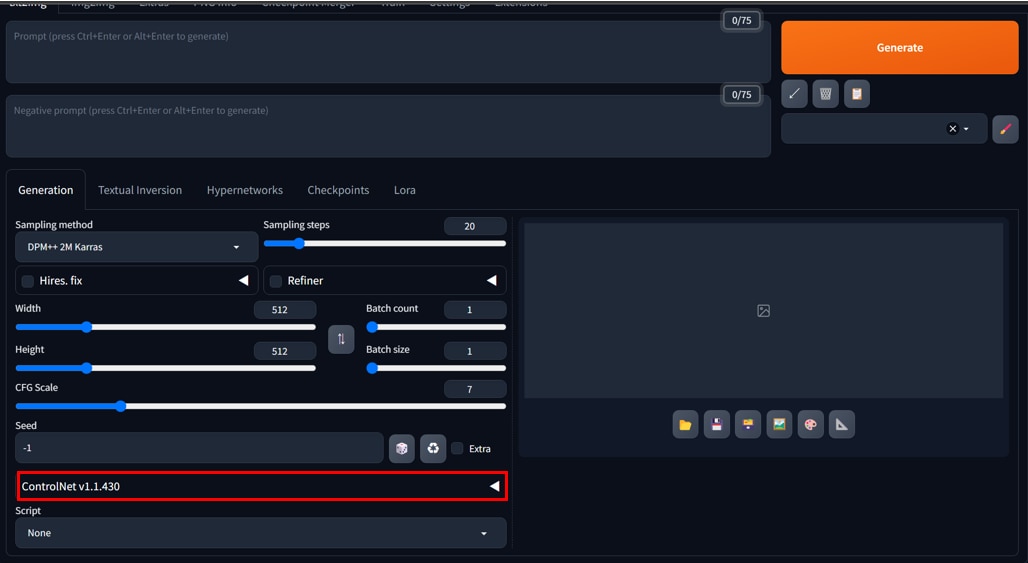

更新が完了したら、[txt2img]タブから[ControlNet v****]が表示されていることを確認します。

ContorlNet専用モデルのダウンロード

ControlNetを利用するためには、前述のControlNetのインストールに加えて、ControlNet専用のモデルをダウンロードする必要があります。

ダウンロードするControlNetのモデルは約30ファイルほど存在します。

一括でモデルをダウンロードする方法と1つずつダウンロードする方法の2通りを紹介します。

1つずつを手動でダウンロードすることは、手間がかかりますので、一括ダウンロードをオススメしています。

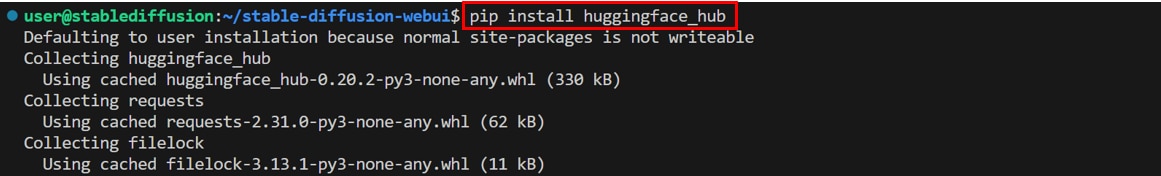

一括でモデルをダウンロードする方法

ControlNetモデルを一括ダウンロードする方法を紹介します。

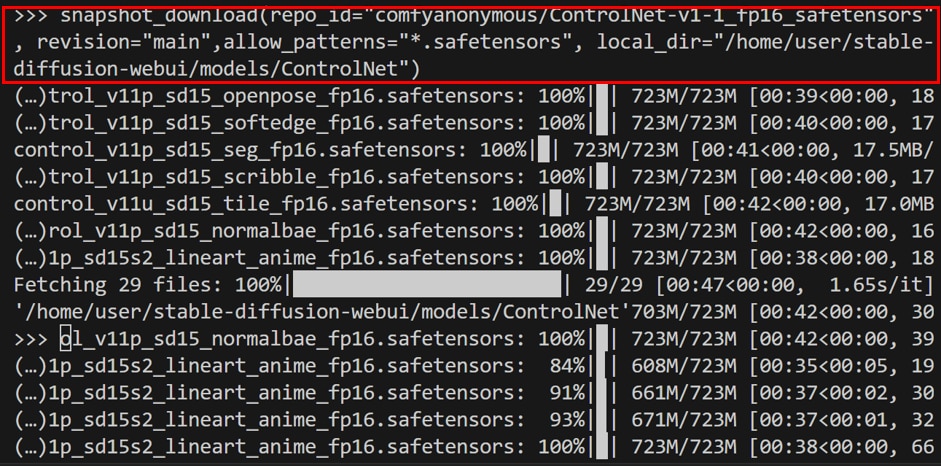

コマンドプロンプトで次のコマンドを実行します。

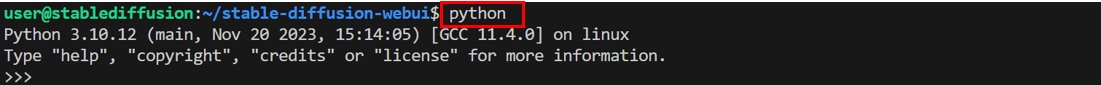

Pythonを起動して次のコマンドを実行します。

![]()

local_dir="xxxx"にはcontrolnetのモデルを格納するパスが入ります。お使いの環境によってパスが異なる場合がありますので、必要に応じて変更してください。

[Ctrl] +[D]キを押して、でPythonインタラクティブモードから抜けます。

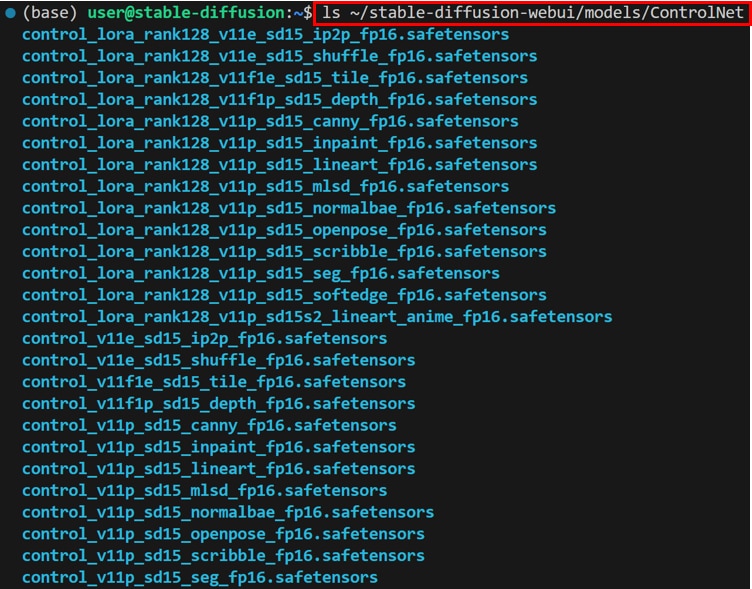

ダウンロードしたモデルが所定のフォルダに格納されているか確認します。

1つずつモデルをダウンロードする方法

ControlNetのモデルを1つずつダウンロードする方法を紹介します。

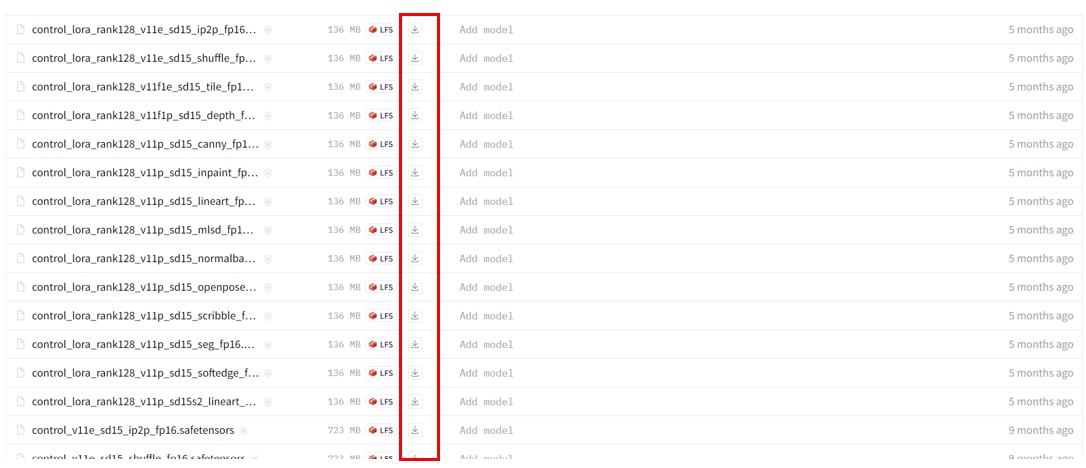

こちらのHugging Faceのページにアクセスしてください。

図に表示されている拡張子safetensorsの複数のファイルがControlNet専用のモデルになります

[ダウンロード]アイコンをクリックして、モデルファイルを1つずつダウンロードしていきます。

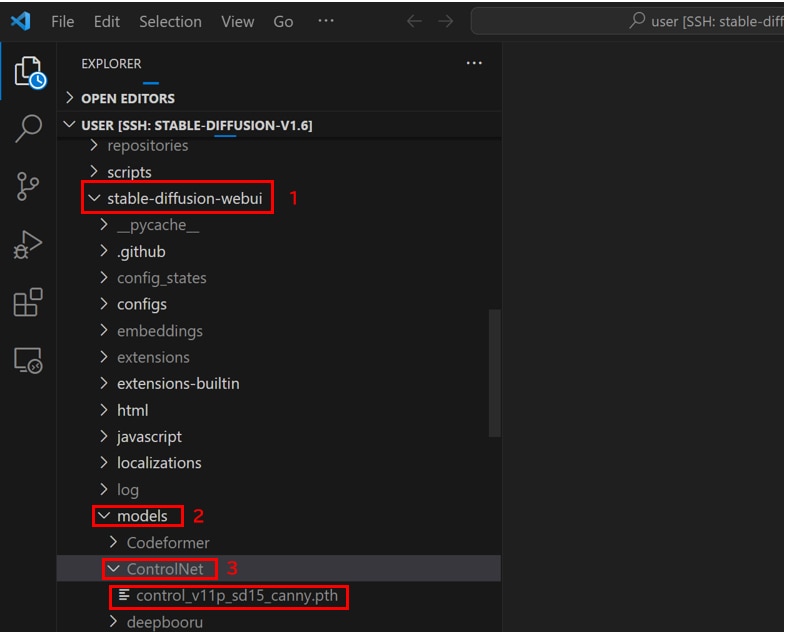

ダウンロードしたモデルファイルを[stable-diffusion-webui] > [models] > [ControlNet]のディレクトリに格納します。

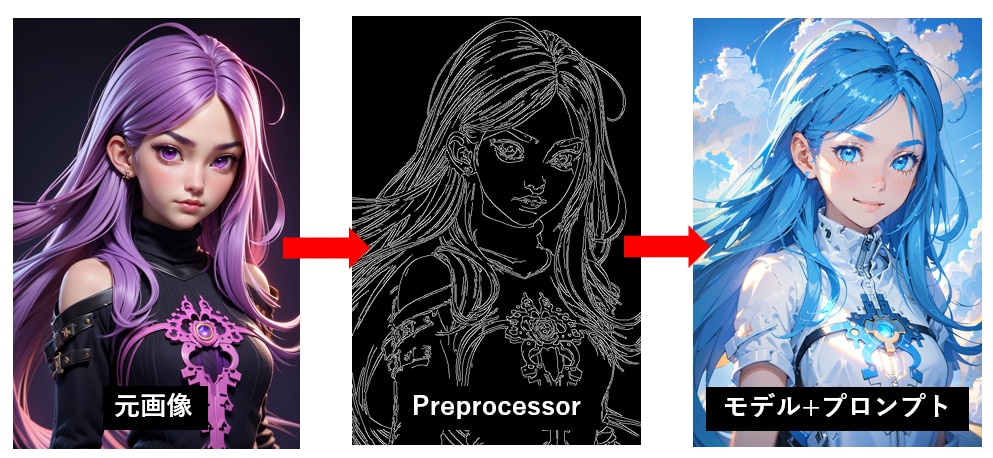

ContorlNet Cannyとは

この記事ではContorlNetのCannyというモデルを使用して画像を生成します。

Cannyは元画像から線画を抽出して、人物の髪や目などの色を自由に変えることができるモデルです。

これによって同じ形をした人物で様々な色合いや画風の画像を生成することができます。

事前準備

事前にCannyに使用する元画像を用意してください。

Stable Diffusionで生成した画像でもよいですし、外部から用意した画像でも構いません。

また元画像は写真、アニメ風、手書きなど制限はありませんが、線画を抽出するので輪郭がはっきりした画像のほうが望ましいです。

この記事では、元画像から線画を抽出し、画風を変換するために、モデル(Checkpoint)を用意しています。

モデル(Checkpoint)は以下のものを使用しました。

モデル(Checkpoint) の使い方は以下の記事で解説しています。

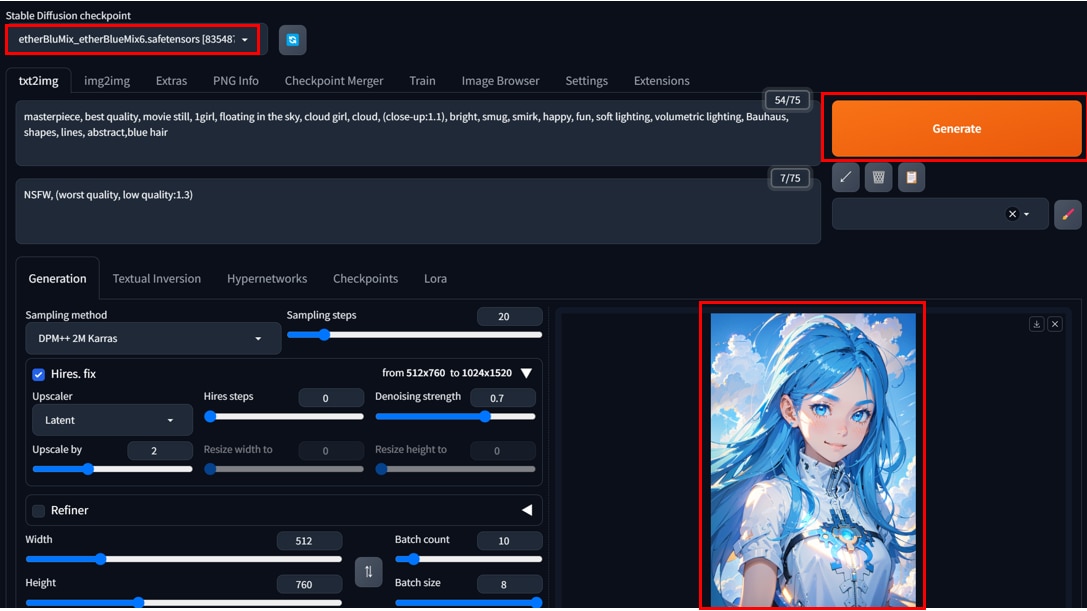

ContorlNet Cannyの設定

ControlNet Cannyの設定手順を紹介します。

Stable Diffusion Web UIを起動します。

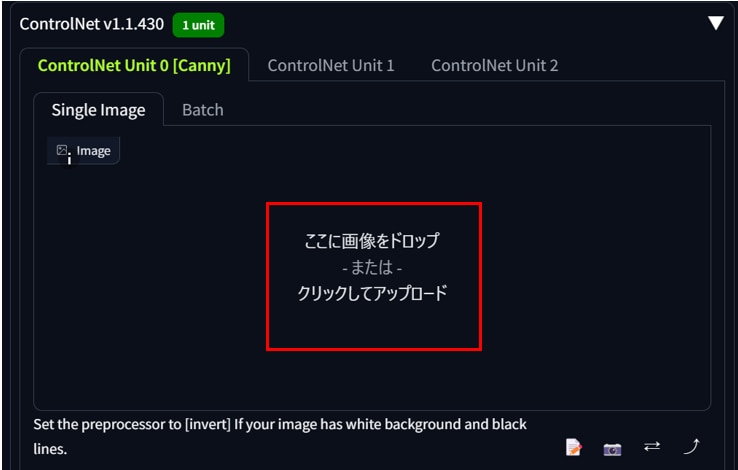

[txt2image]の[ControlNet v****]の[◀]アイコンをクリックします。

[Sigle Image]の[ここに画像をドロップまたはクリックしてアップロード]に元画像をドラッグ&ドロップでアップロードします。

この元画像は線画を抽出するための画像になります。

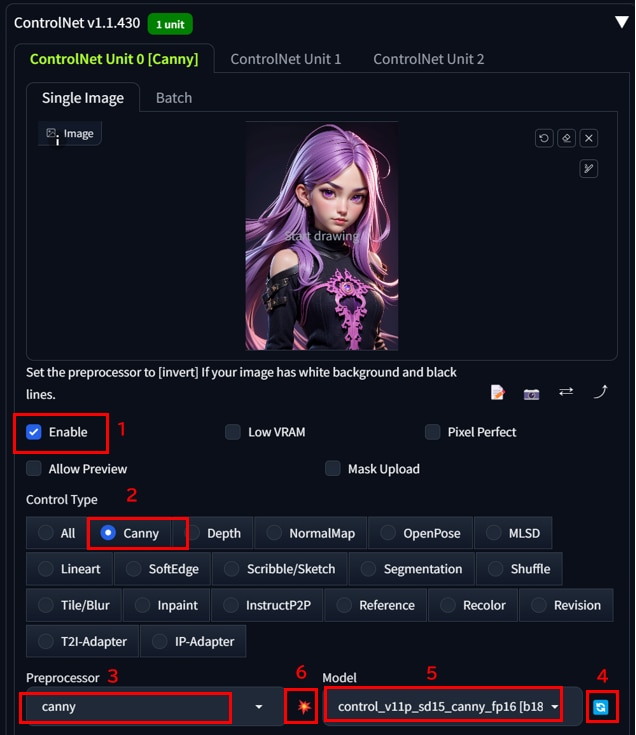

元画像のアップロードが完了したら、以下の手順でControlNet Cannyの設定をします。

- [Enable]にチェックを入れます。

- [Control Type]で[Canny]を選択します。

- [Preprocessor]のプルダウンメニューから[Canny]を選択します。

- [Model]の[更新]アイコンをクリックし、プルダウンメニューから[control_v11p_sd15_canny_fp16]を選択します。

- 特徴抽出をする[💥]のアイコンをクリックします。

設定が完了したら、モデルをセットし、[Prompt]にテキストを入力して、[Generate]をクリックします。

この記事では実行したプロンプトは以下のとおりです。

元画像の線画を維持したまま、アニメ風の画像を生成しました。

左が「元画像」、真ん中が「抽出した線画(Preprocessor)」、右が「抽出した線画にモデル+プロンプトの要素を加えた画像」になります。

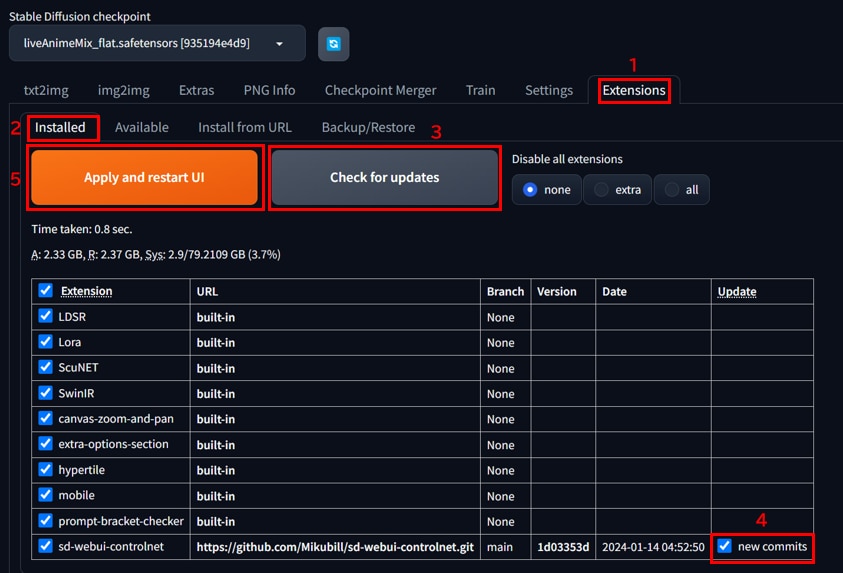

ContorlNetをアップデートする方法

ContorlNetをアップデートする方法は以下のとおりです。

- Stable Diffusion Web UIの[Extensions]タブを開きます。

- [Installed]タブを開きます。

- [Check for updates]ボタンをクリックします。

- [Update]に[latest(最新版)]または[new commits(更新可能)]、[unkown(不明)]が表示されます。

- [Apply and restart UI]ボタンをクリックするとControlNetを含む拡張機能が一括で更新されます。

もっと自由な画像生成を

Stable Diffusionを実行する環境で、次のような悩みをお持ちではないでしょうか?

- 画像生成が遅い

インストールするのが面倒

GPUメモリ(VRAM)が足りない

ソフトウェアの更新や管理が手間

高速かつ格安に画像生成がしたいなら、インストール不要でブラウザで使える「PICSOROBAN」がおすすめです!

今なら約2時間分無料でPICSOROBANの画像生成をお試しいただけます。

まとめ

この記事では、Stable Diffusion Web UIにControlNetをインストールする方法を紹介しました。

ControlNetを使うことで、元画像を参考に生成する画像のコントロールがしやすくなります。

Stable Diffusionに関する記事を以下のページでまとめていますので、あわせてご覧ください。